概要

個人用LLMコマンドラインツールキット。テキストを名前付きタスクにパイプして処理済み出力を得ます。Ollama経由のローカルモデルとクラウドAPI(OpenAI・Anthropic)の両方をサポートします。macOSではクリップボードとシステム通知と連携します。

特徴

- ユーザー定義の指示を単一の設定ファイルで管理する名前付きタスク

whichlang-cliによる自動言語検出つき翻訳- 全プロバイダーからのストリーミング出力

- スタンドアロンCLIとしても,ライブラリとしてsourceしても動作

動作環境と依存関係

必須

| 依存 | バージョン | 備考 |

|---|---|---|

bash | v3.2 以上 | macOSの内蔵バージョンと互換 |

curl | — | HTTPリクエスト |

jq | — | JSON処理 |

オプション

| 依存 | 用途 |

|---|---|

whichlang-cli | 翻訳時の自動言語検出(16言語対応) |

ollama | ローカルモデルの実行 |

インストール

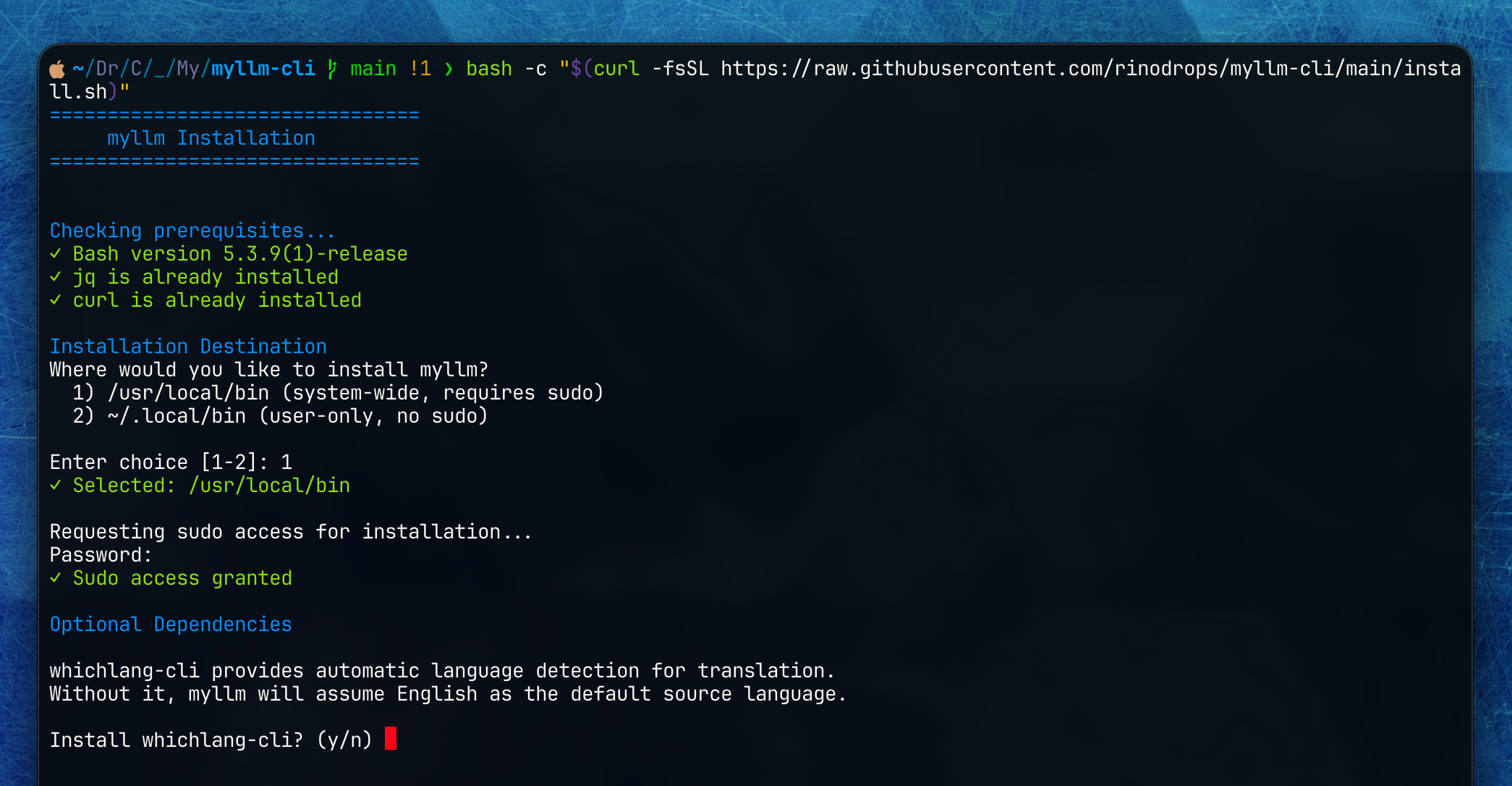

インタラクティブなインストーラーを実行します。

bash

bash -c "$(curl -fsSL https://raw.githubusercontent.com/rinodrops/myllm-cli/main/install.sh)"

インストーラーが行うこと

- 必須依存(

jq・curl)の確認と,不足時のインストール提案 myllmを/usr/local/binまたは~/.local/binにインストールwhichlang-cliのインストール(任意)~/.config/myllm/config.tomlをデフォルトテンプレートから作成

クイックスタート

1. プロバイダーの設定

まず ~/.config/myllm/config.toml でプロバイダーを設定します。Ollamaを使う場合はデフォルトのままで動作します。

toml

[general]

default_provider = "ollama"

[providers.ollama]

base_url = "http://localhost:11434"

default_model = "llama3.2"クラウドAPIを使う場合は設定リファレンスを参照してください。

2. タスクの定義

toml

[tasks.polish]

name = "Polish"

instruction = '''

Improve the clarity and correctness of the provided text.

Output only the revised text, no explanation.

Use the same language as the original text.

'''3. 実行

bash

# テキストをパイプ

echo "draft email" | myllm polish

# 引数として渡す

myllm polish "draft email"

# 利用可能なタスクを一覧表示

myllm list詳細なコマンド仕様はコマンドリファレンスを参照してください。